Efecto ELIZA

From Wikipedia, the free encyclopedia

El efecto ELIZA, en ciencias de la computación, es la tendencia a asumir, inconscientemente, que los comportamientos informáticos son análogos a los comportamientos humanos.

En su forma más específica, el efecto ELIZA se refiere sólo a «la susceptibilidad de las personas a buscar una mayor comprensión en cadenas de símbolos —en especial las palabras— insertados por computadoras».[1] Un ejemplo trivial de esta forma del efecto Eliza, dada por Douglas Hofstadter, implica un cajero automático que muestra la palabra «GRACIAS» al final de una transacción. Alguien poco observador podría pensar que la máquina está en realidad expresando gratitud; sin embargo, la máquina sólo está imprimiendo una cadena preprogramada de símbolos.[1]

De manera más general, el efecto ELIZA describe cualquier situación[2][3] donde, basándose únicamente en la salida del sistema, los usuarios perciben los sistemas informáticos como si tuvieran «cualidades y habilidades intrínsecas controladas por el software que posiblemente no podrían lograr»[4] o «suponen que las salidas reflejan una mayor causalidad de lo que realmente significan».[5] Tanto en su forma específica como en la general, el efecto ELIZA es notable ya que ocurre incluso cuando los usuarios del sistema son conscientes de la naturaleza determinada de la salida producida por el sistema. Desde un punto de vista psicológico, el efecto ELIZA es el resultado de una disonancia cognitiva sutil entre la conciencia del usuario ante las limitaciones de programación y su comportamiento hacia la salida del programa.[6] El descubrimiento del efecto ELIZA fue muy importante para el desarrollo en la inteligencia artificial, demostrando el principio de utilizar la ingeniería social en lugar de la programación explícita para pasar la prueba de Turing.[7]

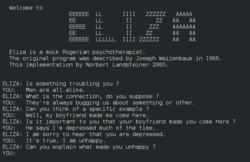

El efecto es nombrado en 1966 a partir del bot conversacional ELIZA, desarrollado por el informático del MIT Joseph Weizenbaum. Al ejecutar el script DOCTOR de Weizenbaum, ELIZA parodió a un psicoterapeuta de la escuela de Rogers, en gran parte al reformular las respuestas del "paciente" como preguntas:

- Humano: Bueno, mi novio me hizo venir aquí.

- ELIZA: ¿Tu novio te hizo venir aquí?

- Humano: Él dice que estoy deprimida la mayor parte del tiempo.

- ELIZA: Lamento escuchar que estés deprimida.

- Humano: Es cierto. Soy infeliz.

- ELIZA: ¿Cree usted que venir aquí le ayudará a no ser infeliz?[8]

Aunque fue diseñado estrictamente como un mecanismo para mantener "conversaciones en lenguaje natural" con un ordenador,[9] el script DOCTOR de ELIZA resultó ser un éxito sorprendente en la obtención de respuestas emocionales de los usuarios que, en el curso de la interacción con el programa, comenzaron a atribuir comprensión y motivación en las salidas del programa.[10] Como Weizenbaum más tarde escribió: "No me había dado cuenta... de que exposiciones extremadamente cortas a un programa de ordenador relativamente simple podrían inducir un poderoso pensamiento delirante en personas bastante normales".[11] De hecho, el código de ELIZA no había sido diseñado para evocar esta reacción en el primer lugar. A partir de esta observación, los investigadores descubrieron que los usuarios asumían, inconscientemente, que las preguntas de ELIZA implicaban interés e involucramiento emocional en los temas tratados, aun cuando conscientemente sabían que ELIZA no simula emoción.[12]